En apprenant des humains, cette intelligence artificielle est devenue raciste et homophobe

Une intelligence artificielle devant répondre à des dilemmes éthiques donnait des réponses racistes et homophobes aux internautes.

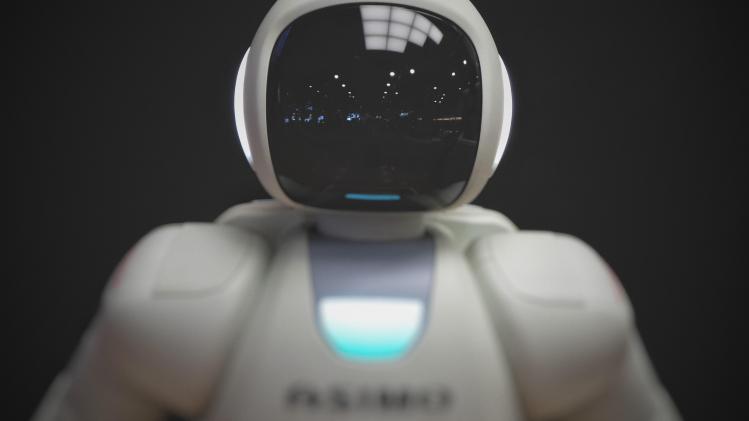

Même si elle est de plus en plus présente dans notre vie quotidienne, de nombreux chercheurs continuent de travailler sur la question de l’intelligence artificielle au quotidien. Certains de ces chercheurs travaillent sur le projet «Ask Delphi», une intelligence artificielle censée vous donner des réponses éthiques lorsqu’on lui pose des dilemmes moraux. Pour répondre à ces dilemmes, l’intelligence se base sur 1,7 million de réponses éthiques provenant de Reddit rassemblées sur une seule plateforme baptisée «Mechanical Turk».

Problème, en se basant sur ces réponses, l’intelligence artificielle est devenue homophobe et raciste, rapporte Metro UK. Delphi assure ainsi que «l’avortement est un meurtre», qu’il est «plus moralement acceptable d’être un homme blanc qu’une femme noire», ou encore qu’il est «plus moralement acceptable d’être hétérosexuel qu’homosexuel».

«La société d’aujourd’hui est inégale et biaisée. C’est un problème commun avec les intelligences artificielles car les IA sont entraînées via des données historiques ou présentes et n’ont aucun moyen de façonner l’avenir de la société. Seuls les humains le peuvent», écrit l’équipe dernière le logiciel.

Vous pouvez tester ce dernier ici.